Navegando pela conformidade da IA em 2025: Principais insights do webinar da Veriff

A IA está reestruturando indústrias em um ritmo sem precedentes, mas com a inovação surgem maiores desafios regulatórios. Como as empresas podem se manter à frente dos requisitos de conformidade em evolução, como o Ato de IA da UE? No último webinar da Veriff, os principais especialistas do setor detalham o que você precisa saber sobre como navegar pelo complexo mundo das regulamentações de IA e seu impacto global.

Chris Hooper

À medida que a inteligência artificial (IA) continua a transformar indústrias ao redor do mundo, as empresas enfrentam um aumento no escrutínio regulatório. No último webinar da Veriff, os especialistas da indústria Chris Hooper (Diretor de Marca, Veriff), Tea Park (Advogado, NJORD Law Firm) e Jeremy Joly (Co-fundador e CPO da Spektr) discutiram o panorama de conformidade em evolução, focando no Ato de IA da UE e suas implicações globais.

Este artigo resume os principais pontos para ajudar as empresas a navegar pela conformidade da IA em 2025, com orientações práticas sobre como atender aos requisitos do Ato de IA da UE, alinhamento com o GDPR e obrigações de sistemas de IA de alto risco.

Entendendo o Ato de IA da UE e seu impacto global

O Ato de IA da UE é uma das estruturas regulatórias mais significativas que governam as tecnologias de IA. Com um amplo escopo, ele se aplica a:

- Empresas baseadas na União Europeia

- Qualquer organização que ofereça serviços ou produtos baseados em IA para usuários da UE

Definições principais sob o Ato

- Sistema de IA – Um sistema baseado em máquinas projetado para operar com variados níveis de autonomia e adaptabilidade, utilizando entradas para gerar saídas, como previsões, conteúdos, recomendações ou decisões que influenciam ambientes físicos ou virtuais.

- Fornecedor – A entidade que desenvolve um sistema de IA.

- Implantador – Uma organização que implementa um sistema de IA em suas operações.

- Importador – Uma empresa que traz soluções de IA desenvolvidas fora da UE para a região.

- Distribuidor – Um negócio que revende ou facilita soluções de IA no mercado.

Compreender onde sua empresa se encaixa dentro dessa estrutura é essencial para a conformidade.

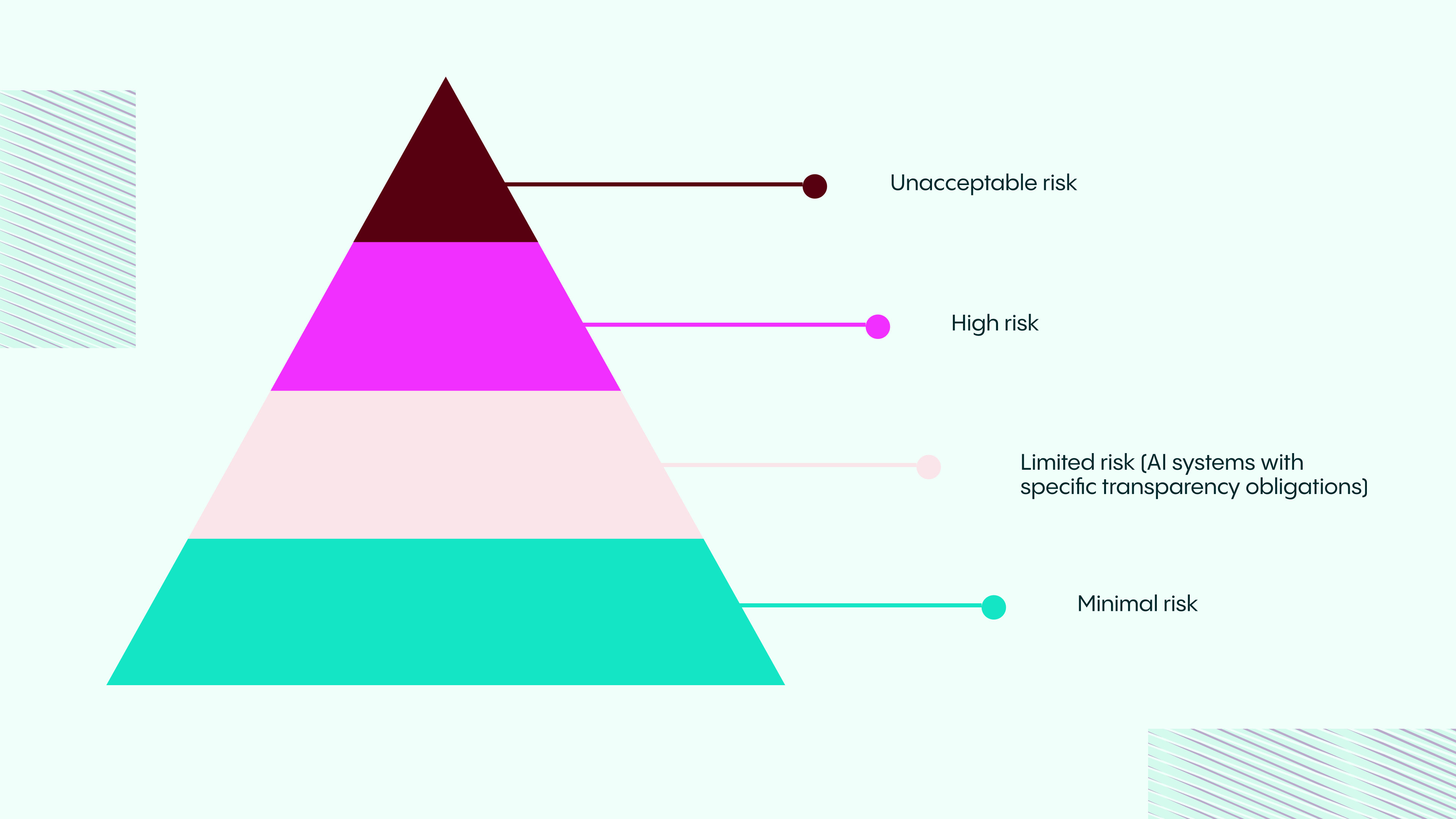

Classificação de risco da IA: O que as empresas precisam saber

Um dos aspectos mais críticos do Ato de IA da UE é sua abordagem baseada em risco, que classifica os sistemas de IA em quatro categorias:

Risco inaceitável (estritamente proibido)

Essas aplicações de IA são banidas devido ao seu potencial de dano a indivíduos e à sociedade. Exemplos incluem:

- Sistemas de pontuação social

- IA usada para policiamento preditivo

- Identificação biométrica remota em tempo real (exceto em ações policiais com salvaguardas rigorosas)

Sistemas de IA de alto risco (obrigações extensivas de conformidade)

As empresas devem implementar rigorosa documentação, gerenciamento de riscos e supervisão humana para sistemas de IA de alto risco, incluindo aplicações em:

- Saúde (por exemplo, diagnóstico assistido por IA)

- Finanças (por exemplo, pontuação de crédito, detecção de fraudes)

- Educação e emprego (por exemplo, avaliações de contratação baseadas em IA)

- Sistemas de IA de risco limitado (obrigações de transparência)

- Aplicações de IA nesta categoria exigem medidas de transparência, como notificações ao usuário ao interagir com conteúdo gerado por IA. Exemplos:

- Chatbots

- Mídia gerada por IA e deepfakes

Sistemas de IA de risco limitado (obrigações de transparência)

Aplicações de IA nesta categoria exigem medidas de transparência, como notificações ao usuário ao interagir com conteúdo gerado por IA. Exemplos:

- Chatbots

- Mídia gerada por IA e deepfakes

Sistemas de IA de risco mínimo (recomendações de melhores práticas)

Essas aplicações de IA não possuem obrigações de conformidade significativas, mas são incentivadas a seguir melhores práticas para o uso responsável da IA.

Datas-chave para observar a conformidade da IA

- 2 de fevereiro de 2025 – Prazo geral de conformidade do Ato de IA da UE

- 2 de agosto de 2025 – Implementação das obrigações de sistemas de IA de alto risco

- 2 de agosto de 2026 – Aplicação mais rigorosa dos requisitos de conformidade

- 2 de agosto de 2027 – Supervisão regulatória em grande escala entra em vigor

Principais passos de conformidade para empresas (Ato de IA da UE e GDPR)

Realizar uma auditoria de IA

Comece identificando todos os processos impulsionados por IA dentro de sua organização e classificando-os de acordo com as categorias de risco do Ato de IA da UE: Inaceitável, Alto Risco, Limitado ou Mínimo. Uma vez categorizados, avalie quaisquer lacunas de conformidade para garantir que você atenda aos regulamentos necessários sem correr o risco de excesso de conformidade ou ficar aquém dos requisitos.

Alinhar-se ao GDPR e às regulamentações de proteção de dados

Os sistemas de IA frequentemente lidam com dados pessoais, tornando a conformidade com o GDPR essencial. Para garantir isso, as organizações devem adotar técnicas que aprimorem a privacidade, como anonimização e minimização de dados para reduzir a exposição a informações pessoais, geração de dados sintéticos para treinar modelos de IA sem usar dados reais de usuários e criptografia junto com processamento seguro de dados para proteger informações sensíveis. Além disso, a adesão aos princípios de processamento legal, incluindo transparência e respeito aos direitos dos titulares dos dados, é vital para manter a conformidade e construir confiança.

Estabelecer mecanismos de supervisão humana

O Ato de IA da UE exige "intervenção humana significativa" em decisões impulsionadas por IA, enfatizando a importância de manter supervisão humana em aplicações de alto risco. Para estar em conformidade, as organizações são incentivadas a nomear oficiais de conformidade de IA ou estabelecer equipes de governança de IA para supervisionar a implementação e adesão às regulamentações. Além disso, é crucial garantir que humanos mantenham a autoridade de decisão final em cenários onde a IA apresenta riscos significativos. Testes regulares de modelos de IA para viés, justiça e responsabilidade também são essenciais para alinhar-se aos padrões do Ato e promover práticas éticas de IA.

Fortalecer a conformidade de fornecedores de IA terceirizados

Se suas soluções de IA dependem de fornecedores externos ou APIs, certifique-se de que os contratos deixem claramente delineadas as responsabilidades de conformidade, verifique se os fornecedores de IA aderem aos padrões do Ato de IA da UE e do GDPR, e realize auditorias e avaliações de impacto regulares dos sistemas de terceiros.

Mantenha-se atualizado sobre as mudanças regulatórias da IA

As regulamentações de IA estão mudando rapidamente, e as empresas precisam se antecipar. É importante acompanhar as atualizações do Ato de IA da UE e outras políticas regionais, participar de discussões do setor e fóruns regulatórios e se envolver em grupos de ética em IA. À medida que novas regras são introduzidas, as empresas devem adaptar suas estruturas de governança de IA para continuar em conformidade.

Considerações finais: Preparando-se para o futuro da conformidade em IA

À medida que as regulamentações de IA estão tomando forma, as empresas devem se preparar proativamente para a conformidade, em vez de reagir a penalizações. Com planejamento estratégico, documentação clara e um foco na implantação ética da IA, as organizações podem se antecipar aos desafios regulatórios enquanto aproveitam a IA para inovação.

O webinar da Veriff enfatizou a importância da transparência, responsabilidade e adaptabilidade na governança da IA. Ao seguir essas informações, as empresas podem garantir conformidade e construir confiança com clientes e reguladores.

Diretrizes de IA recomendadas para empresas:

- Diretrizes da Comissão Europeia sobre a "Definição de Sistema de IA"

Leia as diretrizes oficiais - Repositório Vivo de Práticas de Alfabetização em IA da Comissão Europeia

Explore o repositório de alfabetização em IA - Opinião 28/2024 do Conselho Europeu de Proteção de Dados sobre IA e Proteção de Dados

Leia a Opinião do EDPB - Diretrizes da Comissão Europeia sobre Práticas de IA Proibidas

Leia as diretrizes oficiais