Artículo de fraude

Peligro de deepfake: IA y la lucha contra los estafadores

Los deepfakes son una amenaza creciente en la verificación de identidad (IDV), con peligros que van desde el intercambio de rostros hasta la sincronización de labios y un aumento en documentos falsos. Sin embargo, las mismas tecnologías que los estafadores explotan – particularmente la inteligencia artificial (IA) – también pueden ser utilizadas para proteger a los usuarios honestos.

Ese fue el tema principal de ‘Deepfakes y el futuro del fraude en línea’, un seminario web que presenté recientemente, donde me acompañaron Liisi German, nuestra gerente de producto, y Vinny Gaglioti, ingeniero de soluciones estratégicas de Veriff.

El peligro es claro. Hemos visto un aumento del 20% en el fraude general año con año, mientras que el 6% de todos los intentos de verificación en 2023 fueron fraudulentos. Los deepfakes son una parte importante – y creciente – del problema, particularmente en términos de intercambios de rostros y modificación de rostros, algoritmos de sincronización de labios, documentos falsos y manipulación de video.

Entonces, ¿cómo han cambiado las cosas – y qué pasos estamos tomando para abordar la amenaza? Aquí hay algunos puntos clave del seminario web.

1. Los deepfakes son más fáciles de hacer – y de mayor calidad

Los deepfakes no son nuevos: en Veriff, hemos lidiado con la amenaza durante años. Liisi dijo que ha enfrentado el desafío de los deepfakes durante sus cinco años trabajando para Veriff. Sin embargo, “se ha vuelto más fácil para los estafadores usar diferentes tipos de herramientas”, dijo.

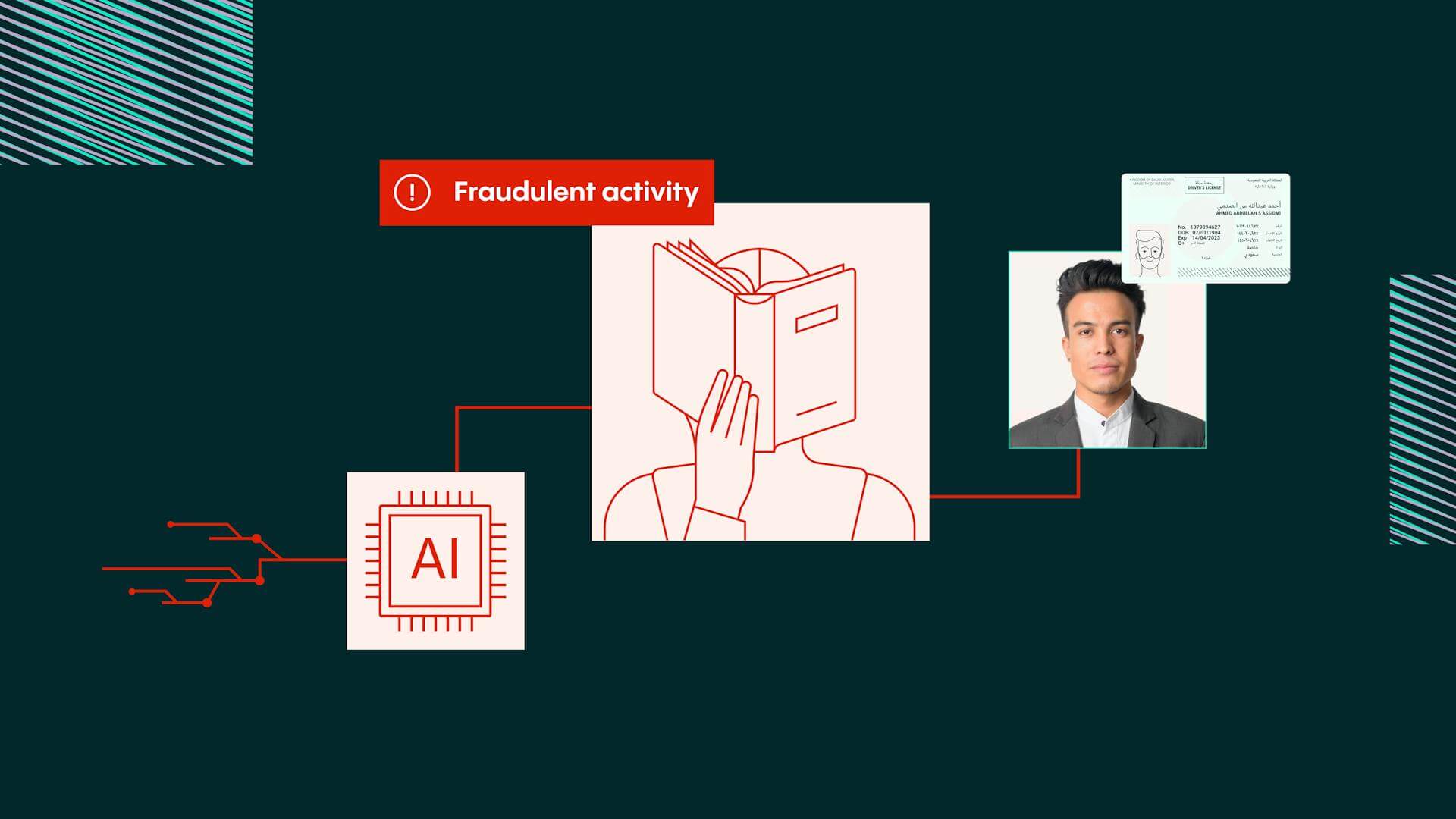

El crecimiento de la IA Generativa (GenAI) es una gran parte del problema. Hoy en día, puedes usar una serie de aplicaciones de generación de imágenes para sintetizar una identidad. Esto está relacionado con el dominio continuo de las redes sociales – con tanta información sobre nuestras vidas publicada en línea, hay un recurso listo para que los estafadores lo aprovechen.

Los deepfakes no son nuevos: en Veriff, hemos enfrentado la amenaza durante años. Liisi dijo que ha enfrentado el desafío de los deepfakes durante sus cinco años trabajando para Veriff. Sin embargo, “se ha vuelto más fácil para los estafadores usar diferentes tipos de herramientas”, dijo.

2. Pero los buenos también pueden usar IA

Los estafadores son habilitados por la IA – pero nosotros también. La tecnología GenAI es tanto la espada como el escudo. Usamos nuestra propia tecnología impulsada por IA – como análisis de dispositivos, códigos de patrones y reglas dinámicas – para construir nuestras capacidades de detección de deepfakes. Cada vez que vemos un deepfake, mejoramos.

La IA y el aprendizaje automático (ML) son fundamentales para los productos de Veriff, señaló Vinny, proporcionando tecnologías avanzadas que a menudo son mejores que los humanos en la detección de anomalías. Sin embargo, la percepción humana sigue siendo clave, dijo.

“Los humanos pueden tener una mejor comprensión del contexto, pueden identificar anomalías, y crean un bucle de retroalimentación,” que puede ser utilizado para mejorar los modelos de IA, explicó Vinny.

German dijo que tanto la tecnología automatizada como el análisis humano entran en juego al identificar indicadores comunes de un deepfake: por ejemplo, examinar los bordes o las esquinas de una imagen en un documento de identificación para determinar si es real, o estudiar una firma para ver si es genuina o uno de los ejemplos comunes producidos por las herramientas que usan los estafadores. Con nuestra base de datos interna de documentos y modelos de puntaje de riesgo de fraude, podemos separar rápidamente lo real de lo falso.

3. Los beneficios de una estrategia de defensa en múltiples capas

La inteligencia humana y las capacidades analíticas son elementos clave de una estrategia de defensa en capas, dijo Vinny a nuestra audiencia. Comparó esto con el enfoque que se tomaba en la época medieval:

“Si tenías un castillo, tal vez también construías un foso – querías tener diferentes tipos de protecciones, para que no dependieras de un solo método para defenderte de los actores maliciosos.”

Por ejemplo, destacó la capacidad de cruce de Veriff: tomar grandes cantidades de datos y buscar patrones que han aparecido antes para determinar resultados futuros. Nuevamente, esto depende tanto de tecnologías automatizadas como de conocimiento e inteligencia humanos.

“Poder combinar todas estas diferentes percepciones y también su experiencia para crear un enfoque realmente completo para la verificación de identidad y para los deepfakes nos ha permitido mantenernos por delante de la curva.”

Los humanos pueden tener una mejor comprensión del contexto, pueden identificar anomalías, y crean un bucle de retroalimentación,” que puede ser utilizado para mejorar los modelos de IA, explicó Vinny.

4. No sobrecorrijas

Es cierto que existen peligros reales en la verificación de identidad, incluyendo deepfakes. Pero no debemos olvidar que la gran mayoría de los usuarios son clientes honestos. De hecho, rechazar erróneamente a un usuario honesto puede resultar más costoso que aprobar accidentalmente un deepfake.

Sobrecorregir y rechazar a clientes potencialmente excelentes – debido al miedo – es un error peligroso. Es vital que encontremos el equilibrio adecuado de manera colaborativa, aprovechando al máximo tecnología avanzada como la biometría y la IA, junto con la experiencia humana.

Deepfakes y el futuro del fraude en línea

En este seminario web, nuestros expertos exploran las últimas tendencias en fraude en línea, con un enfoque en la creciente amenaza de los deepfakes y los medios sintéticos.