✨ Principais conclusões do Relatório Veriff Deepfake Deep Dive

Descubra a verdadeira ameaça da IA generativa e como cultivar um ecossistema de prevenção a fraudes é a única maneira de manter seus negócios seguros

Chris Hooper

1. A ameaça da IA está se tornando mais sofisticada

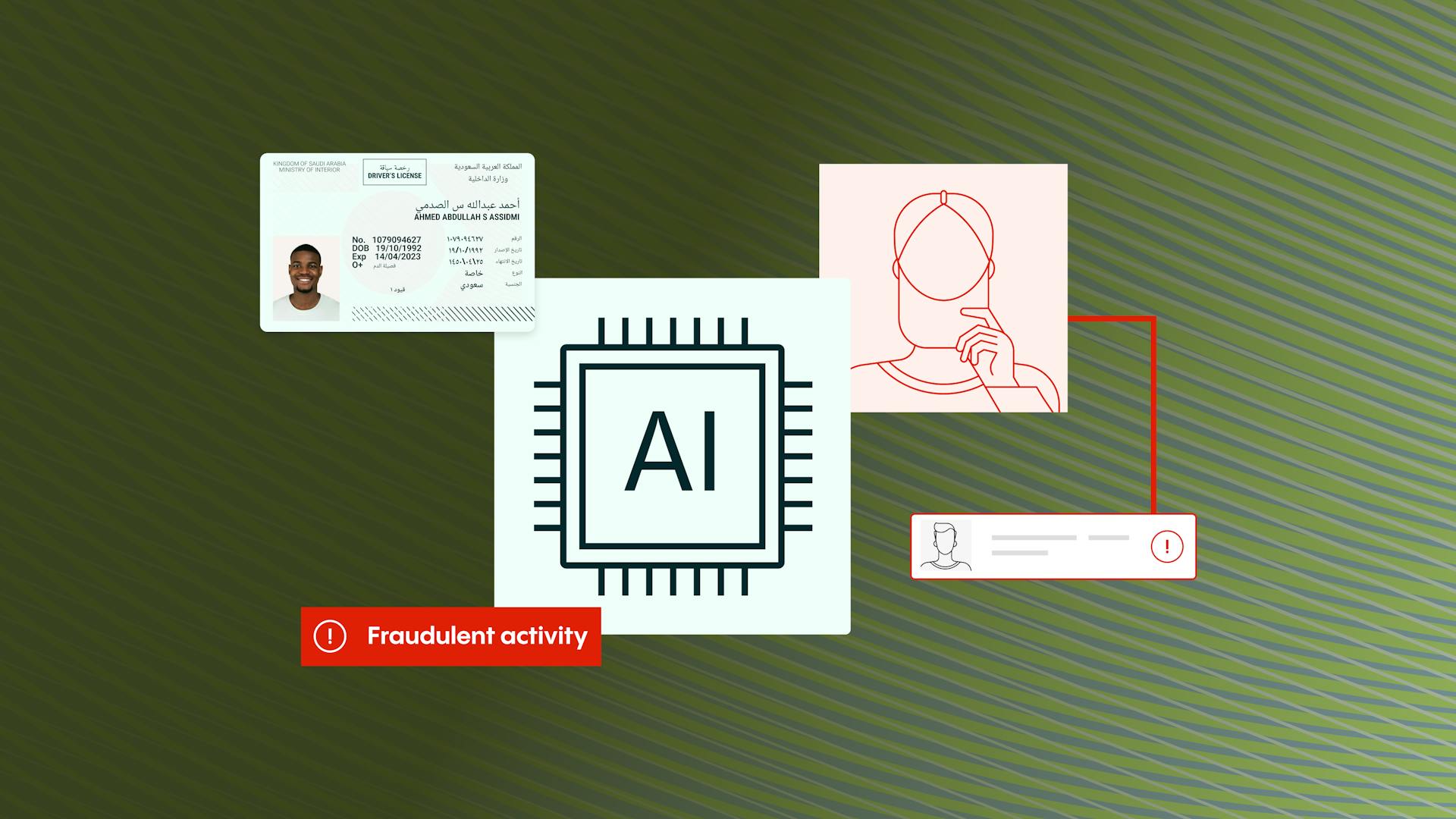

A inteligência artificial (IA) está transformando a economia digital – e apresentando novas oportunidades para os golpistas. Como os especialistas em fraudes podem reagir e proteger seus negócios do perigo em evolução?

O Relatório Veriff Deepfake Deep Dive explora esta questão em detalhes - delineando a verdadeira extensão da ameaça da IA para os negócios e, crucialmente, o que pode ser feito para reagir.

Aqui estão as principais conclusões:

A ameaça da IA está se tornando mais sofisticada.

Documentos fabricados têm sido um desafio de segurança de longa data para plataformas online. No entanto, a IA generativa intensificou a ameaça, permitindo que criminosos criem documentos falsos e deepfakes, vídeos e conteúdos de áudio que são muito mais convincentes do que nunca, com cerca de 500.000 deepfakes de voz e vídeo compartilhados ao redor do mundo em 2023.

A qualidade e a sofisticação da ameaça são impulsionadas pela IA generativa. Esses modelos agrupam algoritmos em redes neurais artificiais que imitam a estrutura do cérebro humano. Eles podem então ser treinados em um nível "mais profundo" para fazer correlações complexas e não lineares entre grandes volumes de dados diversos e não estruturados.

Como resultado, modelos de aprendizado profundo podem aprender de forma independente de seu ambiente e de erros passados para realizar tarefas com um padrão extremamente alto – incluindo criar áudios e vídeos falsos. Por exemplo, existem modelos que imitam a geração de novas imagens e textos que parecem reais. Eles aprendem a partir de imagens e textos do mundo real e geram algo que os humanos não conseguem distinguir como sendo real ou gerado pela IA.

2. As ameaças de IA mais comuns que você precisa conhecer

Identificamos cinco técnicas comuns adotadas por golpistas ao utilizarem IA e aprendizado profundo em suas atividades. Elas são:

- Troca de rostos, quando o rosto de uma pessoa é sobreposto a uma foto de outra pessoa

- Sincronização labial, onde algoritmos mapeiam uma gravação de voz de conteúdo de áudio a um vídeo de alguém dizendo algo diferente

- Fantoches, onde os movimentos desejados de um ator são sobrepostos ao sujeito alvo, fazendo com que o ‘fantoche’ pareça se mover como o ‘mestre’

- GANs e Autoencoders: GANs são treinados com dados da internet e redes sociais sobre expressões faciais e movimentos. Eles são então combinados com um autoencoder para criar um avatar digital fictício

- Embora tecnicamente não utilizem IA generativa, documentos falsos podem ser gerados utilizando modelos, ferramentas de edição de fotos e scripts para criar documentos que parecem reais.

Examinaremos essas técnicas em mais detalhes no Relatório Veriff Deepfake Deep Dive.

3. O impacto dos deepfakes

Os deepfakes são especialmente eficazes quando utilizados contra empresas com processos de gestão de identidade desarticulados e inconsistentes e baixa cibersegurança. Eles podem ser usados tanto para atacar contas existentes quanto para abrir novas fraudulentamente.

Os resultados mais comuns que estamos vendo incluem:

- Abertura de contas fraudulentas: Identidades sintéticas e documentos falsificados estão sendo cada vez mais utilizados para passar por verificações biométricas durante a etapa Know Your Customer (KYC) do processo de integração

- Tomada de conta (ATO): Deepfakes sofisticados são combinados com outras técnicas de hacking para obter acesso a contas existentes

Neste relatório examinaremos em detalhes como a ameaça da IA e deepfake está evoluindo e o que os negócios podem fazer para garantir que eles e seus usuários estejam protegidos.

4. Não há uma solução mágica

Para ficar à frente dos golpistas, você precisa de uma abordagem em constante evolução e em várias camadas que combina uma série de ferramentas de mitigação de ameaças. Infelizmente, não existe uma solução única para combater a fraude de identidade, especialmente quando atores mal-intencionados utilizam o tipo de tecnologia sofisticada de deepfake que está se tornando cada vez mais disponível.

Em vez disso, você precisa empregar uma abordagem coordenada e multifacetada que combina verificações rigorosas nas informações fornecidas com uma variedade de informações contextuais.

Isso deve incluir:

- Verificações robustas e abrangentes em documentos de identidade afirmados

- Exame das principais características do dispositivo

- Tratar a ausência de dados como um fator de risco em certas circunstâncias

- Contrar IA para identificar manipulação de imagens recebidas

- Procurar ativamente padrões em várias sessões e clientes

- Análise biométrica de imagens fotográficas e de vídeo fornecidas

Para a Veriff, a primeira linha de defesa são nossas tecnologias automatizadas. Se a IA não consegue determinar se um documento é real ou não, o enviamos para especialistas humanos para sua análise.

Nossas defesas em camadas analisam a pessoa, seu documento de identidade afirmado, rede e dispositivo, minimizando o risco de manipulação e garantindo que apenas pessoas confiáveis e genuínas tenham acesso aos seus serviços. Além disso, os mecanismos que usamos para detectar fraudes (incluindo deepfakes) não são visíveis para o usuário e, como tal, são mais difíceis de reverter.

Saiba mais